Gemini、いじってみました。

結論としては、画像・音声・動画・テキストの「理解」には優れている一方で、「生成に関してはテキストのみ」という感じです。

・画像の差別問題の解消

・マルチモーダルとしての活用

を期待してみましたが、、、

「五感でインプットして学習能力と言語化能力は凄いが、創作はできない。」みたいなイメージです。

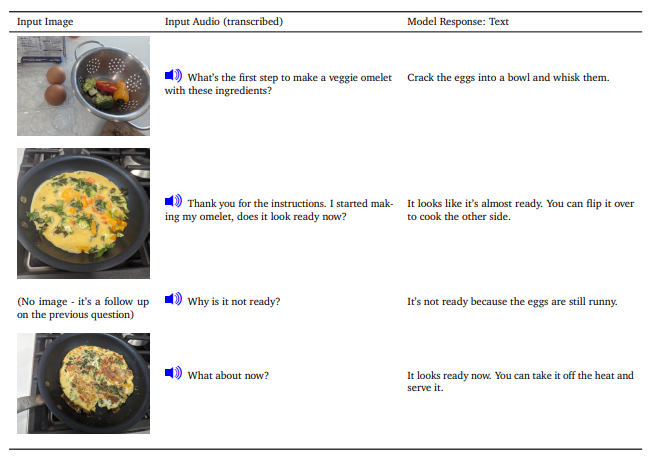

以下は、画像と音声を拾ってオムレツが完全に、オムレツが完全に焼けたかどうかを評価するデモ。

クリエイターの時代と言われているので、マルチなコンテンツをあのクオリティで生成までできることを証明したOpenAIが一強な理由も納得できます。

Google APIからすぐに活用できます。

テキスト

model = genai.GenerativeModel('gemini-pro')

response = model.generate_content("What is the meaning of life?")model = genai.GenerativeModel(‘gemini-pro’) chat = model.start_chat(history=[])

> 画像からテキスト

model = genai.GenerativeModel(model_name=”gemini-pro-vision”) response = model.generate_content([“What’s in this photo?”, img])

Google APIからすぐに活用できます。 > テキスト model = genai.GenerativeModel(‘gemini-pro’) response = model.generate_content(“What is the meaning of life?”) > チャット model = genai.GenerativeModel(‘gemini-pro’) chat = model.start_chat(history=[]) > 画像からテキスト model = genai.GenerativeModel(model_name=”gemini-pro-vision”) response = model.generate_content([“What’s in this photo?”, img])

https://ai.google.dev/tutorials/python_quickstart

> 本レポートでは、画像、音声、動画、テキスト理解にまたがる驚くべき能力を発揮する、マルチモーダルモデルの新ファミリー「Gemini」を紹介する。

https://storage.googleapis.com/deepmind-media/gemini/gemini_1_report.pdf